NLP|不拆分单词也可以做NLP,哈工大最新模型在多项任务中打败BERT( 二 )

文章插图

结果,WordBERT-ZH在四项任务中都打败了所有其他对比模型,在全部五项任务上的表现都优于基线BERT,并在TNEWS(分类)、OCNLI(推理)和CSL(关键字识别)任务上取得了3分以上的差距。

这说明,基于词的模型对中文也是非常有效的。

最后,实验还发现:

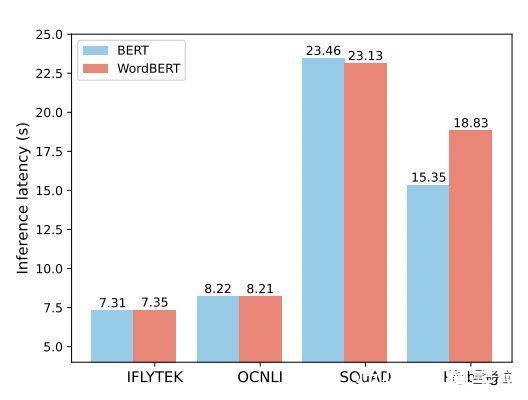

性能不差的WordBERT,在不同任务上的推理速度也并未“落于下风”。

文章插图

关于作者一作为哈工大计算机专业在读博士生冯掌印,研究方向为NLP、文本生成。

文章插图

他曾在微软亚研院自然语言计算组、哈工大和科大讯飞联合实验室实习,在NLP领域的顶会ENNLP发表过一篇一作论文。

通讯作者为史树明,来自腾讯AI Lab。

文章插图

论文地址:

https://arxiv.org/abs/2202.12142

— 完 —

量子位 QbitAI · 头条号签约

- 京东|裁员不忘膈应人,这家互联网大厂送的离职礼物恶心到我了!

- 踩线|主播不“踩线” 直播才有未来

- 厨房|刀可切菜灶可加热 儿童厨房玩具安全不能忽视

- 华为|意识到离不开中国了?外媒称华为、中兴或将重新打入美国市场

- 章子怡扎减龄丸子头,短裙露美腿不像生过娃,从影20年笑容依旧甜

- 恒大|中国恒大回应被清盘呈请:极力反对 预期不影响重组计划

- ios16|一步到位能用5年,目前这3款手机能闭眼入,买手机不要太小气

- 月球也在太阳系的宜居带中,为何不能产生生命?原来个头太小了

- 太空中的真菌毒素是否危害宇航员健康?科学家:尚不明确

- 显卡|3个不买RTX 3080的理由:没钱只能排最后